IA-forismos

1. La expresión “inteligencia artificial” (IA) suele aplicarse a un conjunto muy heterogéneo de prácticas científicas y tecnológicas. Eso es nocivo para su cabal comprensión.

Basta pensar que IA alude en ocasiones a dispositivos bélicos y vehículos autónomos, software de reconocimiento facial, sistemas de apoyo al diagnóstico médico, generadores de imágenes artísticas (como Dall-E y Leonardo.ai), o de respuestas bien redactadas, no siempre acertadas, sobre cualquier tema que se les solicite (ChatGPT y Bard son apenas dos de los programas más conocidos).

2. Geoffrey Hinton, después de renunciar a su trabajo en Google como desarrollador de productos de IA, declaró: “Se pueden advertir tres peligros a corto plazo: la creación de contenido digital cuya veracidad será imposible de comprobar para el usuario promedio, el reemplazo de trabajadores en una amplia gama de oficios y que los sistemas de IA se conviertan un día en armas autónomas, especies de robots asesinos” (Hinton, 2023: p. 5)

3. En cuanto a las dificultades para distinguir la verdad de las noticias, o la autoría de una producción intelectual o artística, eso es un problema que se viene planteando desde siempre. La IA no hace más que agravarlo. No fue ajena a ello, ni a las oleadas periódicas de fake news, mi presentación de 2023 sobre “Constructivismo y realismo: desde la filosofía a los medios masivos”, en el VI Coloquio de Investigación en Comunicación (UDEM, México).

La buena noticia es que se han escrito libros breves pero contundentes para enfrentar ese tipo de cuestiones y desarticular la atmósfera cultural y filosófica que los propicia: Posmodernismo, razón y religión de Ernest Gellner (1992); Las ilusiones del posmodernismo de Terry Eagleton (1997); La importancia de la verdad para una cultura política decente de Michael Lynch (2004); Convencidos pero equivocados. Guía para reconocer espejismos en la vida cotidiana de Thomas Gilovich (2009); Posverdad de Lee McIntyre (2018). Eso en lo ético y lo filosófico.

4. En lo técnico, quienes hemos interactuado largas horas con los más célebres programas de IA generativa en distintos ámbitos, sabemos lo mucho que se equivocan. Educar para estar alertas ante los engaños es un viejo y noble proyecto de la Ilustración. Conocer libera, se ha repetido con razón.

Por ejemplo, es menester difundir que las precariedades inherentes de los algoritmos obligan a un apoyo constante por parte de trabajadores de carne y hueso, cuyo trabajo suele ser precarizado además de permanecer invisible. Lo explican de modo elocuente investigaciones como la involucrada en Trabajadores fantasmas de Sandrine Rigaud (2020) hasta los informes de DW (2023) que llegan a interrogarse sobre el “¿Colonialismo de la IA?”.

Ocurre que, por un lado, se requiere entrenar a la IA para clasificar objetos como es debido. Por otro, no es sencillo para la IA (y a veces para un ser humano) diferenciar con seguridad un video porno de una ficción artística, o un video “snuff” de un montaje cinematográfico. La investigación de Sandrine Rigaud (2020) llevó entre otras cosas, a enterarse de los juicios que los “trabajadores fantasma” han venido haciendo contra sus empleadores, por los trastornos psíquicos que les habría generado contemplar durante meses contenidos violentos.

5. Para enfrentar los eventuales impactos negativos de la IA, la enseñanza de ciencia y tecnología es necesaria pero no es suficiente. Investigar sobre IA requiere enfoques de múltiples disciplinas y sus cruzamientos. En particular, la filosofía de la tecnología y la filosofía en general, involucran herramientas conceptuales sin las cuales es muy difícil, si no imposible, comprender muchos de los aspectos en juego. Por su virtud de transversalidad, es vital en Uruguay la enseñanza de la filosofía en ése y en cualquier otro ámbito (Guzmán, 2023).

6. He aquí otra de las preocupaciones de Geoffrey Hinton, bien fundada, por cierto: las amenazas de la IA por el “reemplazo de trabajadores en una amplia gama de oficios”, sea que vistan un overol azul, o que luzcan corbata y cuello blanco. La huelga de actores, guionistas y otros empleados en servicios que convergen en la industria cinematográfica de Hollywood, constituye un buen ejemplo.

Me he ocupado de las distintas aristas de estos asuntos en varias oportunidades. Por ejemplo, presentamos en 2022 junto al cineasta argentino Gustavo Carbonell el avance de investigación “Tecnología y empleo: ¿quedará algo sin automatizar?”, en el V Coloquio en Comunicación, Universidad de Monterrey (UDEM, México). Por fortuna, el dar respuesta a esos peligros en forma cabal, ya se ha debatido de muchas maneras. Veamos una posible respuesta , que podrá compartirse o no, pero ofrece un buen insumo para pensar.

7. “Este libro está dedicado a todas las personas con habilidades no automatizables –artesanía, creatividad y empatía–, condicionadas por una realidad que no les permite emerger” (Munyo, 2021: p. 3). Esa dedicatoria de El futuro de los humanos de Ignacio Munyo resume bien lo que podemos esperar de los impactos múltiples de la automatización y de la IA sobre el empleo en general y el trabajo no rutinario en particular. Porque en realidad la producción artesanal seguirá siendo portadora de valor, las aplicaciones de IA serán magníficos copilotos de los creadores de guiones, videos y piezas musicales; la afectividad y la empatía no se han podido simular de modo verosímil hasta ahora.

8. Pero ¿qué pasará con las personas que cumplen tareas amenazadas de automatización? Munyo propone una renta básica sectorizada. Así lo explica el autor: “¿Qué va a pasar con las personas que tienen experiencia y formación en tareas robotizables? No hay respuestas. Por eso es necesario pensar en las posibilidades de implementar una renta básica. No universal, sino para un grupo bien definido de la población. En ese sentido, se debería considerar el caso de una renta básica asignada a personas cuyas habilidades laborales ya han quedado obsoletas o tienen alto riesgo de ser automatizadas” (Munyo, 2021: p. 140).

9. Luego de evaluar positivamente la experiencia de renta básica en Finlandia, Munyo sostiene: “El Estado tiene un rol clave a jugar (…) La capacitación para el futuro del trabajo pasó de ser una necesidad lejana a una prioridad inmediata. Decenas de miles de trabajadores en Uruguay necesitan apoyo del Estado para poder mirar con esperanza el futuro” (Munyo, 2021: p. 144). Se requiere liderazgo del Estado para cuidar a quienes no se les puede soltar la mano, porque las dificultades que parecen ahorrarse por un lado, se multiplicarán en otros ámbitos de la vida en sociedad. Eso en cuanto a los oficios tradicionales.

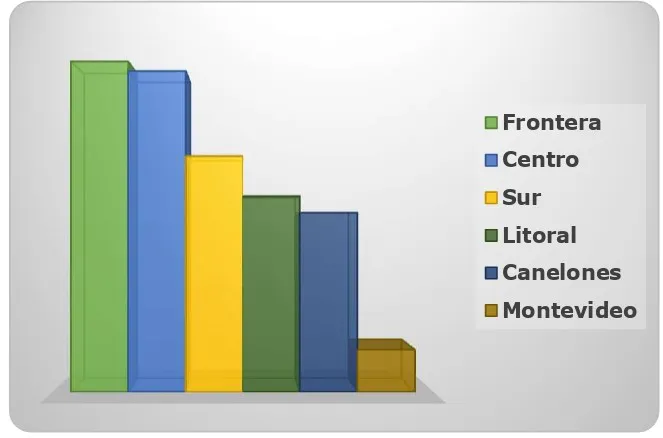

10. ¿Pero qué ocurre con las labores más creativas? ¿La IA no sustituirá al programador o al investigador científico? El Uruguay está preparado para la IA porque ya ha dado muestras de su capacidad para innovar disruptivamente en tecnología y ser creativo en ciencia. Esto significa que, por ejemplo, distintas modalidades de la IA ya han sido utilizadas por científicos uruguayos en colaboración con extranjeros y empresas tecnológicas gestadas en el Uruguay. Aunque ya no está en manos de sus fundadores, es el caso del software Genexus (2023). También debe mencionarse el uso de algoritmos de deep learning sobre las marcas de posible origen humano en los huesos de megafauna del Arroyo del Vizcaíno, Canelones (Domínguez-Rodrigo et alter, 2021). La IA no vino a ocupar su lugar, sino a potenciar sus emprendimientos e incrementar sus chances de probar hipótesis.

11. ¿Qué pasa con el impacto de la IA en la educación? En el Uruguay existe una experiencia acumulada difícil de encontrar en el mundo: la del Plan Ceibal. Hay muchos elementos para sostener que uno de los efectos más relevantes de esa disrupción educativa, sin perjuicio de los que puedan señalarse en otras áreas (o incluso discutirse), fueron los procesos de empowerment de estudiantes, familiares y docentes.

Es algo que refleja muy bien el libro de Ana Solari La revolución Ceibal. El sueño que cumplió 10 años (2017) y el extraordinario documental de Pablo Casacuberta Soñar robots (2021) sobre la exitosa participación de estudiantes uruguayos del interior en certámenes internacionales de robótica. Más modestamente, en 2023, fui responsable de la ponencia “La evaluación en cuestión. ¿Por qué no medir el empowerment?” en el XII Encuentro de Filosofía e Historia de la Ciencia en el Cono Sur en la Universidad del Valle, Cali, Colombia, organizado por AFHIC. Educandos, educadores y la sociedad entera debe mirar allí, hacia los numerosísimos logros de la generación Ceibal.

Para una perspectiva actualizada de IA y educación, vale la pena ver completas las excelentes conferencias de Sánchez Mendiola (2023) y Lecumberry y Fariello (2023).

12. En cuanto a las armas autónomas y “los robots asesinos”, la tercera de las preocupaciones de Geoffrey Hinton, no es algo que admita una respuesta fácil. Tampoco el uso político canallesco de algoritmos Big Data como los utilizados por la empresa Cambridge Analytica gracias a los datos privados de millones de usuarios de Facebook. Las manipulaciones políticas gigantescas, que involucraron al Brexit, a Donald Trump y a procesos electorales de numerosos países, fue documentado con rigor en el libro de Brittany Kaiser La dictadura de los datos y el documental Nada es privado de Amer y Noujaim (ambos son de 2019). Ese será el tema de nuestro próximo artículo. Ahora pasemos a otros asuntos, más filosóficos.

13. Aunque el mal ya está hecho, para comprender lo inadecuada que es la expresión “inteligencia artificial” recordemos que Arturo Ardao, historiador de las ideas y filósofo original, distinguía “inteligencia” de “razón”. Y lo explicaba con aforismos. He aquí algunos: “Cuando Pascal distinguía entre esprit de géométrie y esprit de finesse, era entre razón e inteligencia que distinguía” / “La inteligencia abarca a la lógica porque incluye a la razón; pero la sobrepasa al incluir al mismo tiempo a la intuición” / “La inteligencia es la razón enriquecida por la intuición, en lo que ésta tiene conjuntamente de imaginación, sentimiento e instinto, es decir, de experiencia” (Ardao, 1993: pp. 153-154).

14. “La luz de la razón ilumina; la lumbre de la inteligencia ilumina y calienta” / Es en la lumbre de la inteligencia que saltan las chispas de las intuiciones” / “Las metáforas, desde las poéticas a las filosóficas, pasando por las coloquiales, no le hablan a la razón: le hablan a la inteligencia” (Ardao, 1993: p. 156). Entretanto, la IA es nada más, ni nada menos por supuesto, que una grandiosa simulación estadística. El propio Ardao lo supo ver hace muchas décadas: “La llamada ‘inteligencia artificial’ debió, debe, llamarse ‘razón artificial’; algoritmia mediante, es la razón, no la inteligencia, la que viene siendo ensayada por las computadoras” (Ardao, 1993: p. 157).

15. Hace ya muchos años, el filósofo John Searle lanzó un golpe contundente a los optimistas ingenuos de la Inteligencia Artificial (tener en cuenta que sus argumentos no tocan en absoluto a los optimistas críticos). Muchos investigadores se afiliaban a la tesis de que sería posible diseñar computadoras capaces de pensar y de trascender las rutinarias tareas que los humanos les asignaron (tales como calcular o procesar textos).

Ellos solían defenderse apelando al Test de Turing. Según Alan Turing (1950), matemático y pionero en estos temas, si no podemos discernir entre las respuestas de una computadora y las de un ser humano provisto de cierta facultad cognitiva, entonces, puede inferirse que la computadora posee dicha facultad. Este criterio behaviorista de Turing y sus seguidores, es el que intenta refutar John Searle. Su contraejemplo, de apreciable elegancia y simplicidad, es conocido como argumento de “la sala china” de Searle (1990: pp. 37 y ss.).

16. Dentro la “sala china” permanece una persona que ignora por completo el idioma chino. Un chino auténtico le pasa una tarjeta a través de cierta ranura en la puerta, con frases escritas mediante bellos e incomprensibles ideogramas. El sujeto dentro de la sala la toma y consulta un catálogo de reglas que muestra los garabatos que debe incluir su respuesta teniendo en cuenta los garabatines enviados en la tarjeta del chino. Cada vez que el hombre dentro de la sala recibe una tarjeta, se fija en el catálogo y envía otra por la ranura de salida. El proceso se repite varias veces. El chino, que no sabe lo que pasa dentro, puede suponer que el responsable de las respuestas conoce su idioma y comprende el significado de los caracteres, pero se equivoca. Eso es parecido a suponer que el loro entiende las palabras que reproduce, o la pared, el eco.

17. La analogía de la sala china es clara: el catálogo es un programa, sus autores son los programadores, la persona dentro del cuarto es la computadora y el chino un usuario que cree que la máquina necesita pensar. El asunto ha generado duras polémicas y cada bando esgrime su propia biblioteca de argumentos. He intentado diseñar algunos propios en “De máquinas y músculos” (Courtoisie, 1995: pp. 66-67). También en “Cuatro falacias de la inteligencia artificial” (Courtoisie, 2010: pp. 222-235).

Los partidarios (ingenuos) de Turing olvidan que por distintos medios puede obtenerse un mismo fin. Para taladrar túneles las máquinas no necesitan músculos y para resolver ciertos problemas los ordenadores no necesitan pensar.

REFERENCIAS

Amer, Karim y Noujaim, Jehane (2019). Nada es privado (The Great Hack). [Netflix]

Ardao, Arturo (1993). Espacio e inteligencia. Montevideo: FCU y Biblioteca de Marcha.

Brooker, Charlie y Pankiw, Ally (2023). «Joan Is Awful». Black Mirror, episodio 1, temp. 6. [Netflix]

Casacuberta, Pablo (2021). Soñar robots [documental].

Courtoisie, Agustín (1995). Para mí los Blanes. Montevideo: Arca. Ver también: https://agustincourtoisie.wordpress.com/2018/04/23/de-maquinas-y-musculos/

Courtoisie, Agustín (2010). A ciencia cierta. Una historia reciente de lo que se sabe. Montevideo: Ministerio de Relaciones Exteriores/ Consejo de Educación Técnico Profesional – UTU. Con los auspicios de Casa de Galicia, SUAT y Universidad ORT Uruguay.

Domínguez-Rodrigo M., Baquedano E., Varela L., Tambusso PS., Melián MJ., Fariña RA. (2021) Deep classification of cutmarks on bones from Arroyo del Vizcaíno (Uruguay). Proc. R. Soc. B 288: 20210711. https://doi.org/10.1098/rspb.2021.0711

DW (2023). “¿Colonialismo de la IA? https://www.youtube.com/watch?v=gf6IDW1lWZ0

Genexus (2023). https://www.genexus.com/es/noticias/leer-noticia/genexus-next-by-globant

Guzmán, Leonardo (2023). “La filosofía en retirada”. En el diario El País: https://www.elpais.com.uy/opinion/columnistas/la-filosofia-en-retirada

Herzog, Werner (2016). Lo and Behold: Reveries of the Connected World.

Hinton, Geoffrey (2023). “¿Serán más inteligentes?”. En Relaciones Nro. 469, junio 2023. Montevideo.

Kantayya, Shalini y Buolamwini, Joy (2020). Prejuicio cifrado (Code Bias). [Netflix]

Lecumberry, Federico y Fariello, Maine (2023). “Aplicaciones de la IA”. En el Ciclo de Conferencias sobre IA y Educación, ANEP. https://www.youtube.com/watch?v=AEq-QJpEi2g

Munyo, Ignacio (2021). La revolución de los humanos. El futuro del trabajo. Montevideo: Debate.

Rigaud , Sandrine (2020). Trabajadores fantasmas. En RTVE: https://www.rtve.es/play/videos/la-noche-tematica/trabajadores-fantasma/6733304/ Enlace alternativo: https://drive.google.com/file/d/1vXtGdaiTBx2-O56wUBtiEM7x1umScrU4/view

Sánchez Mendiola, Melchor (2023). “ChatGPT y la IA generativa: ¿salió el genio de la botella?”. En Foro Internacional de IA en Docencia Científica. https://www.youtube.com/watch?v=iY_abLUn2v0

Searle, John (1990). Mentes, cerebros y ciencia. Madrid: Cátedra.

Spielberg, Steven (2002). Minority Report. [Netflix]

Turing, Alan (1950). “Computing Machinery and Intelligence”. Mind 49: 433-460. https://philpapers.org/rec/TURCMA

Rosa Luxemburgo: Una Llamada a la Actualidad en la Lucha por los Derechos y la Justicia Social